Drei Leipziger Unternehmen und Einrichtungen forschen gemeinsam an einem neuen Empfehlungssystem für audiovisuelle Medien. An dem Projekt MANGAN sind neben dem Leipziger Hörbuchverlag und Audiodienstleister BUCHFUNK das Rechenzentrum der Uni Leipzig sowie die Digitalagentur ifabrik beteiligt. Gefördert wird das Projekt, das vor einigen Tagen offiziell gestartet wurde, vom Bundesministerium für Bildung und Forschung im Rahmen des Programms KMU-innovativ.

Hörbuch, Podcasts, Filme: Konkurrenz um Aufmerksamkeit

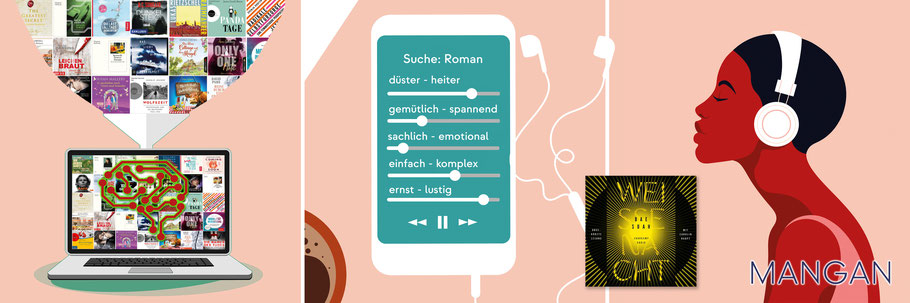

Immer mehr Hörbücher, Hörspiele aber auch Podcasts, Radioreportagen und nicht zuletzt filmische Inhalte ̶ von der Talkshow bis hin zu Spielfilmen ̶ konkurrieren um die Aufmerksamkeit der Menschen. “In dieser Masse an Angeboten wollen die Menschen nicht ewig nach etwas Passendem suchen”, sagt BUCHFUNK-Geschäftsführer Johannes Ackner. Und: “Um Inhalt und Nutzer:innen effizienter zusammenzubringen, wollen wir ein Verfahren entwickeln und anwenden, mit dem Metadaten automatisch aus Audioinhalten extrahiert werden.” Das neue System will BUCHFUNK zunächst bei seinem seit 2003 betriebenen Hörbuchportal vorleser.net einsetzen und erproben – später aber auch für andere Anwender öffnen. Für die Implementierung des Systems ist die Digitalagentur ifabrik an Bord.

Ann-Kristin Meyer ist bei BUCHFUNK für die wissenschaftliche Arbeit verantwortlich. “Neben bekannten Informationen, wie Inhaltsangabe oder Genres, sollen zusätzliche Metadaten extrahiert werden”, so die Neurowissenschaftlerin. “Audioinhalte liefern uns weit mehr Informationen als reiner Text. Die menschliche Stimme ist ein wichtiger Indikator für die Gefühlslage und kann uns womöglich dabei helfen, herauszufinden, wie der Inhalt einzuordnen ist, ob er zum Beispiel lustig oder traurig, spannend oder beruhigend ist”, so Meyer weiter.

Suchverfahren basiert auf Stimmungen, Absichten und Zusammenhängen

Auf Basis dieser neuen Metadaten würde dann eine intuitive Suche entwickelt und erprobt, die einen zielgerichteten, individuellen Zugang zu gesprochenen Inhalten ermöglicht. Dr. Stephan Klingner vom Rechenzentrum der Uni Leipzig (URZ) ergänzt: “Wir nennen es ‘MIC-Profil’, wobei die Buchstaben MIC für Mood, Intent und Context stehen – also ein Suchverfahren bezeichnen, das auf Stimmungen, Absichten und Zusammenhängen basiert.”

Künstliche Intelligenz

Auf der technischen Seite gehe es gleichzeitig darum herauszufinden, welche Informationen sich mit Hilfe welcher Methode aus den Audioinhalten herauslesen lassen, so Klingner. Denn Audioinhalte böten die einmalige Chance, Informationen sowohl auf Basis der Stimme als auch auf Grundlage des Inhaltes abzuleiten. Hier sollen neben klassischen Extraktionsverfahren auch KI-basierte Ansätze genutzt werden.

Derzeit versuchen Meyer, Klingner und Co., besser zu verstehen, wie Gefühlslage und Situation die Auswahl der Hörer:innen beeinflussen. In welcher Stimmung ziehen sie zum Beispiel das Sachbuch einem Roman vor? Und weil Audioinhalte oft “nebenbei” konsumiert werden, stellt sich die Frage, in welchen Situationen bestimmte Audioinhalte gehört werden: Für die Zeit des Einschlafens fällt die Wahl womöglich anders aus als beim Sport. Welche dieser Faktoren tatsächlich einen Einfluss auf die Auswahl haben, wird derzeit erforscht ̶ mit Hilfe von Interviews, Nutzungsdaten und Umfragen.

Assoziierte Partner: Schwergewichte aus Deutschland und Europa

Die drei Unternehmen des MANGAN-Konsortiums werden von sechs assoziierten Partnern unterstützt. “Wir konnten namhafte deutsche und europäische Unternehmen gewinnen, wie Europas größten Buchhändler Thalia, das Hörbuch-Streamingportal BookBeat aus Schweden oder den Hörbuchverlag Argon”, so Johannes Ackner. Mit dem Deutschen Zentrum für barrierefreies Lesen (dzb) sei eine weitere Leipziger Institution an Bord, von der man sich auch wertvolle Impulse zum Thema Barrierefreiheit erhoffe. “Aus unserer Sicht hat das Vorhaben das Potential, den Zugang der Menschen zu gesprochenen Audioinhalten wesentlich zu erleichtern. Es könnte damit perspektivisch sogar geeignet sein, bestehende Standards der gesamten Branche zu ergänzen”, sagt dzb-Direktor Prof. Dr. Thomas Kahlisch.

Das Forschungsprojekt ist zunächst auf drei Jahre ausgelegt. “Bis dahin sollen die Metadatenextraktion aus Audiodaten und die intuitive MIC-Suche marktreif sein”, hofft Ackner.